AI巨头较量,谁能赢得企业信任,AI走进企业,安全和合规先行,智能再强,也需信任护航,数据是命脉,安全是底线,让企业安心用AI,微软这样做

💁♂️引言

上周,我连续追看了微软、谷歌和Anthropic三大AI巨头的年度发布会。现场展示的AI新技术令人目不暇接,一时激情澎湃。但当我关掉直播屏幕,静下心来思考,内心却生出几分冷静与自省——AI的”大时代”已然到来,我们每个人又该以怎样的姿态拥抱这场浪潮?

接下来,我想用7张图,把”AI周”最震撼的技术时刻和我的一点冷静思考分享给你 👉第1张图:Microsoft Build 2025

🏢 微软篇:企业为核心,信任为基石 —— 全栈AI安全的示范路径

⚡ 微软AI战略八要素

- 🏢 以企业AI为核心,

- 🔒 以“可信AI”为抓手,

- 🛡️ 以数据安全为前提,

- 🕵️♂️ 以网络隐私双保障,

- 🌐 以生态开放为路径,

- ☁️ 以云边端协同为亮点,

- 🛠️ 以Agent能力为驱动力,

- 🧩 以可验证信任为根本。

🚀 结论先行:AI深入企业,安全合规与信任并重

微软在 Build 2025 发布会上,用一套极具前瞻性的AI战略,再次定义了“企业级AI”的新标准。所有创新都服务于同一个命题:AI要深入企业,数据安全和合规必须先行,信任才能真正生根发芽。

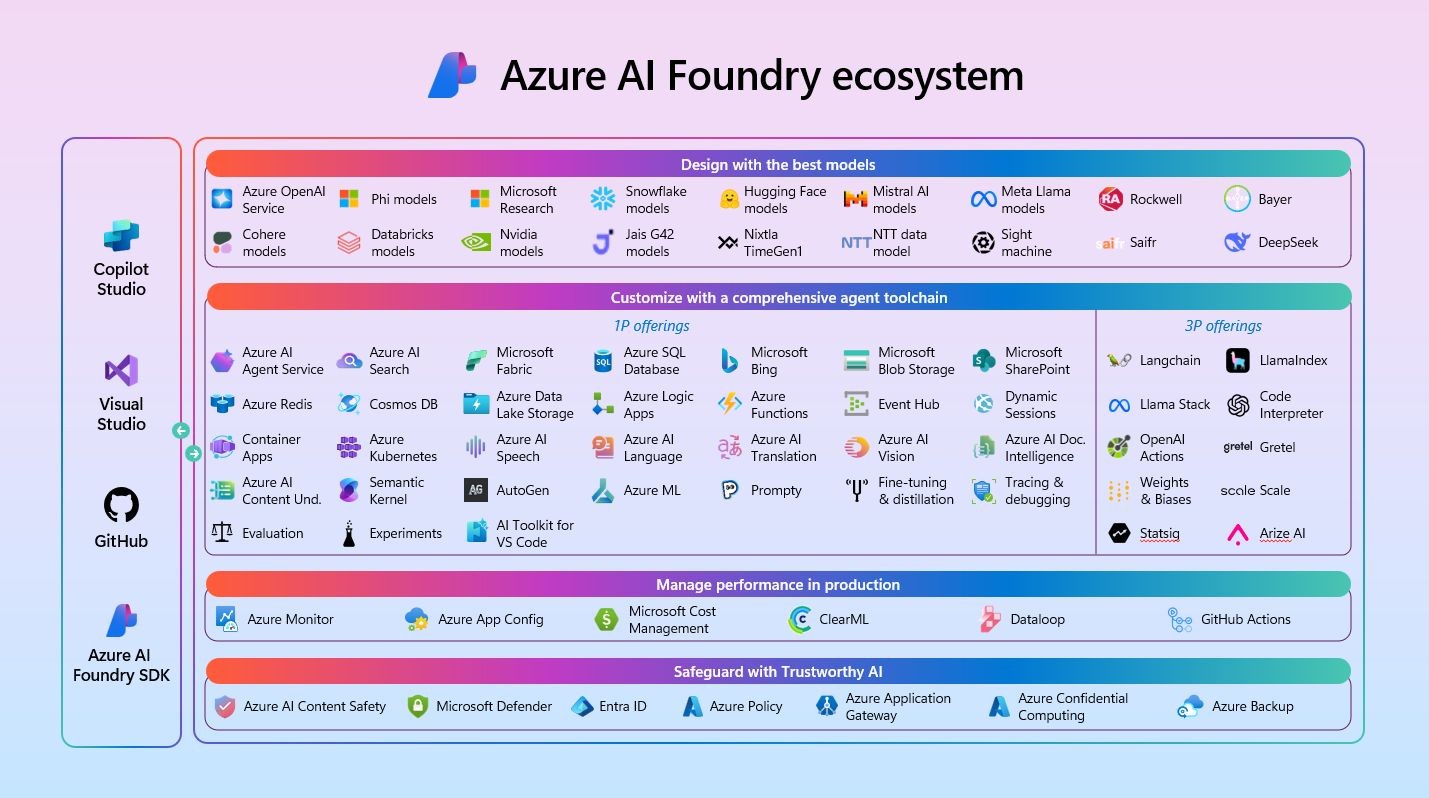

🏢 企业级AI为核心:Copilot定制与全场景赋能

微软今年推出了 Microsoft 365 Copilot Tuning,允许企业用自己的专属数据微调大模型,让AI助手真正贴合企业的知识体系和业务流程。这一设计不仅提升了AI落地的实用性,更为数据隔离和隐私保护打下坚实基础。与此同时,Azure AI Foundry 汇聚了来自 OpenAI、xAI、Hugging Face 等主流与开源模型,为企业提供丰富的模型选择与灵活的定制空间。

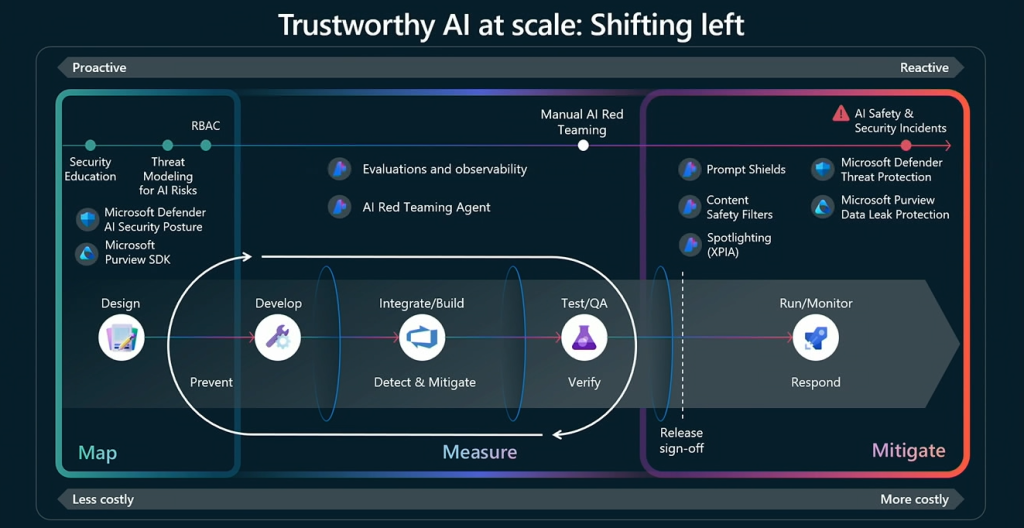

🔒 “Trustworthy AI”信任升级:让安全合规可验证

微软将AI的安全理念从“Responsible AI”升级为“Trustworthy AI”,不仅仅是口号上的变化,更是能力与治理体系的全面跃升。本次Build大会同步推出多项企业级AI安全措施,贯穿数据、内容、身份和合规治理全链路:

- Prompt Shield:为AI输入设立防火墙,拦截恶意和“越狱”指令。

- Spotlighting:自动检测外部内容中的攻击型Prompt,守住数据入口。

- Task Adherence:智能体行为越界实时预警,确保AI始终在授权范围内工作。

- Defender集成 & PII检测:安全建议与隐私保护前置到开发全流程,敏感信息自动识别与处理。

微软让安全治理不再停留在承诺,而是变成“看得见、用得上、可审计”的能力闭环,为企业上AI再添一层护城河。

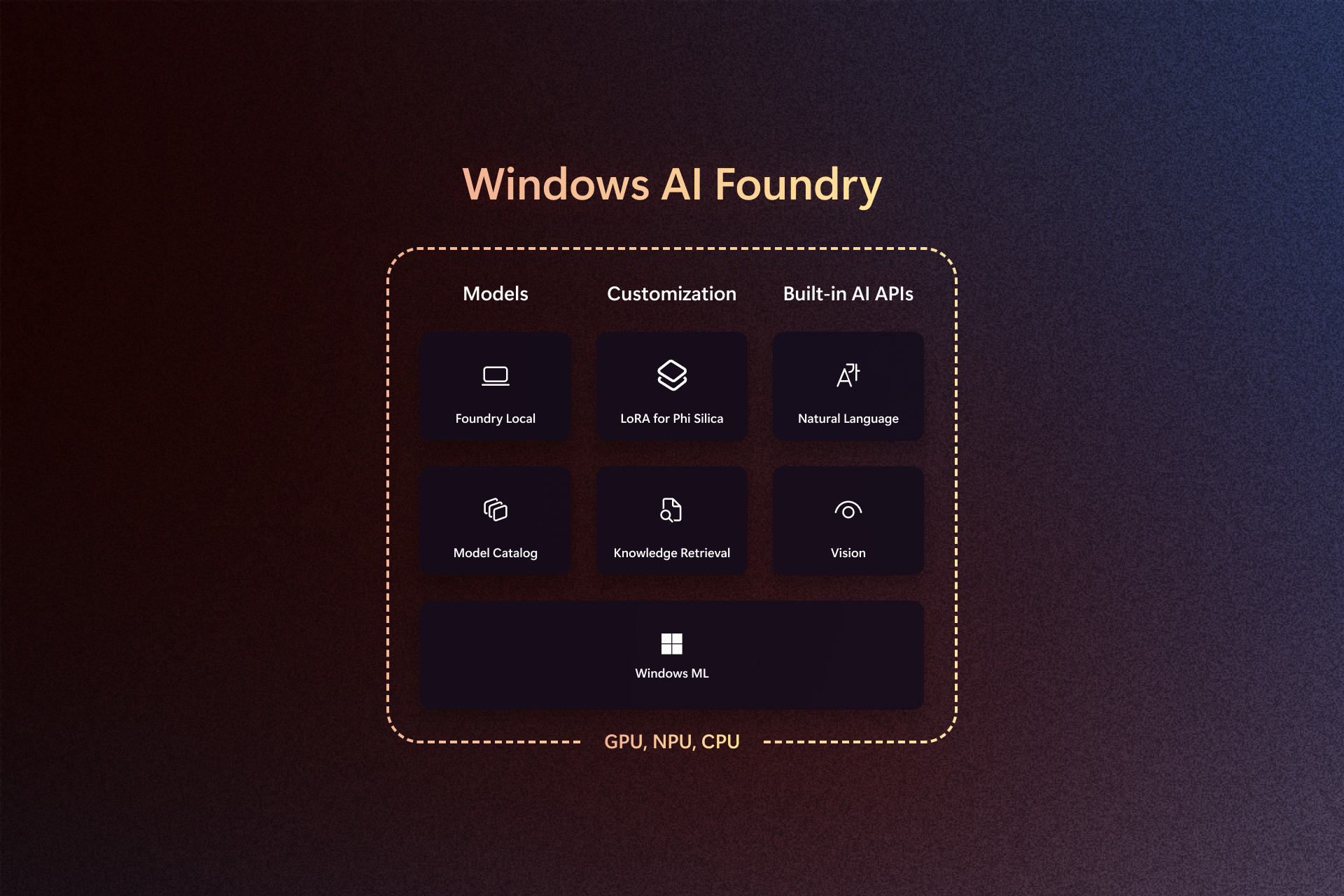

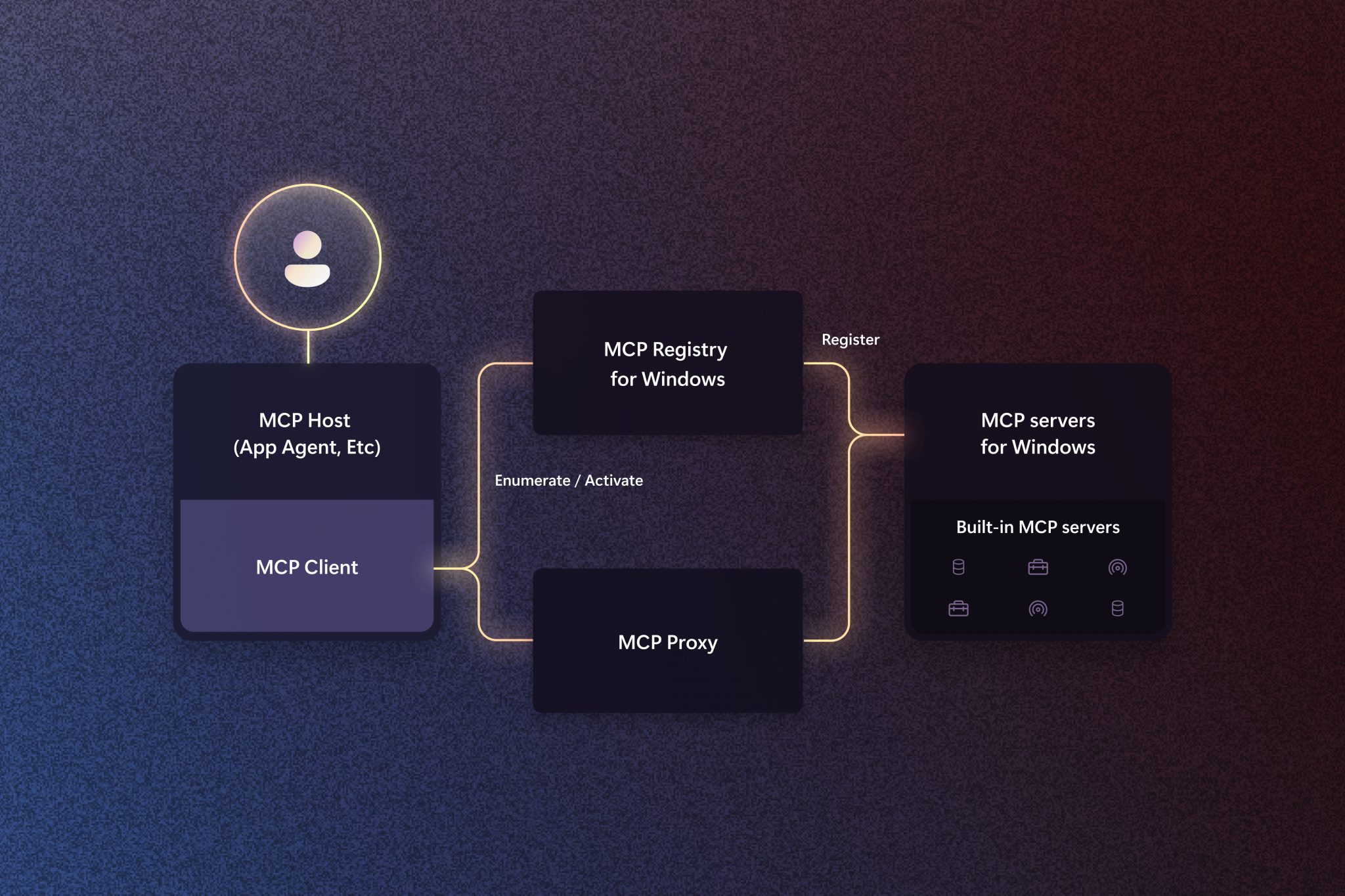

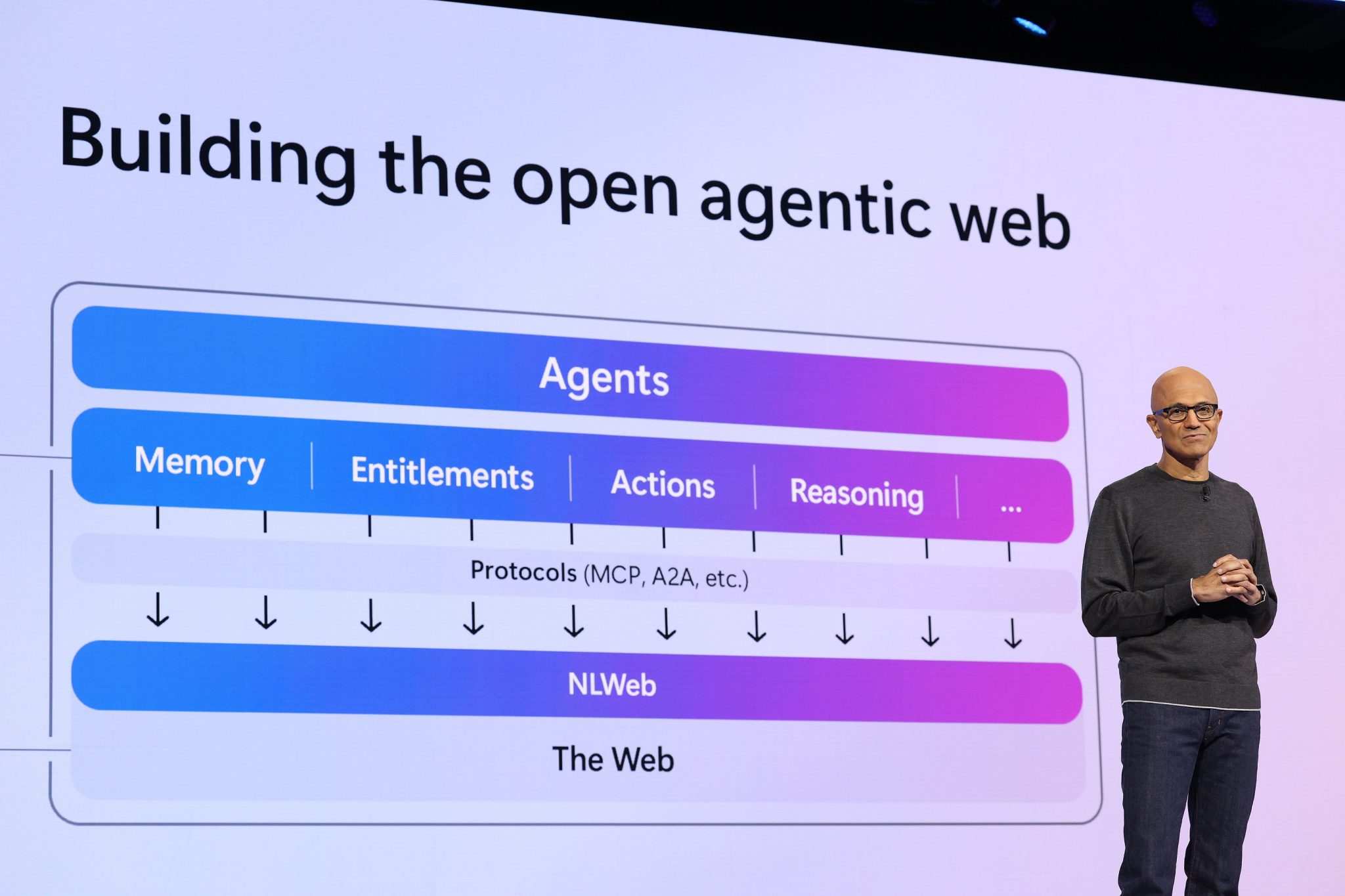

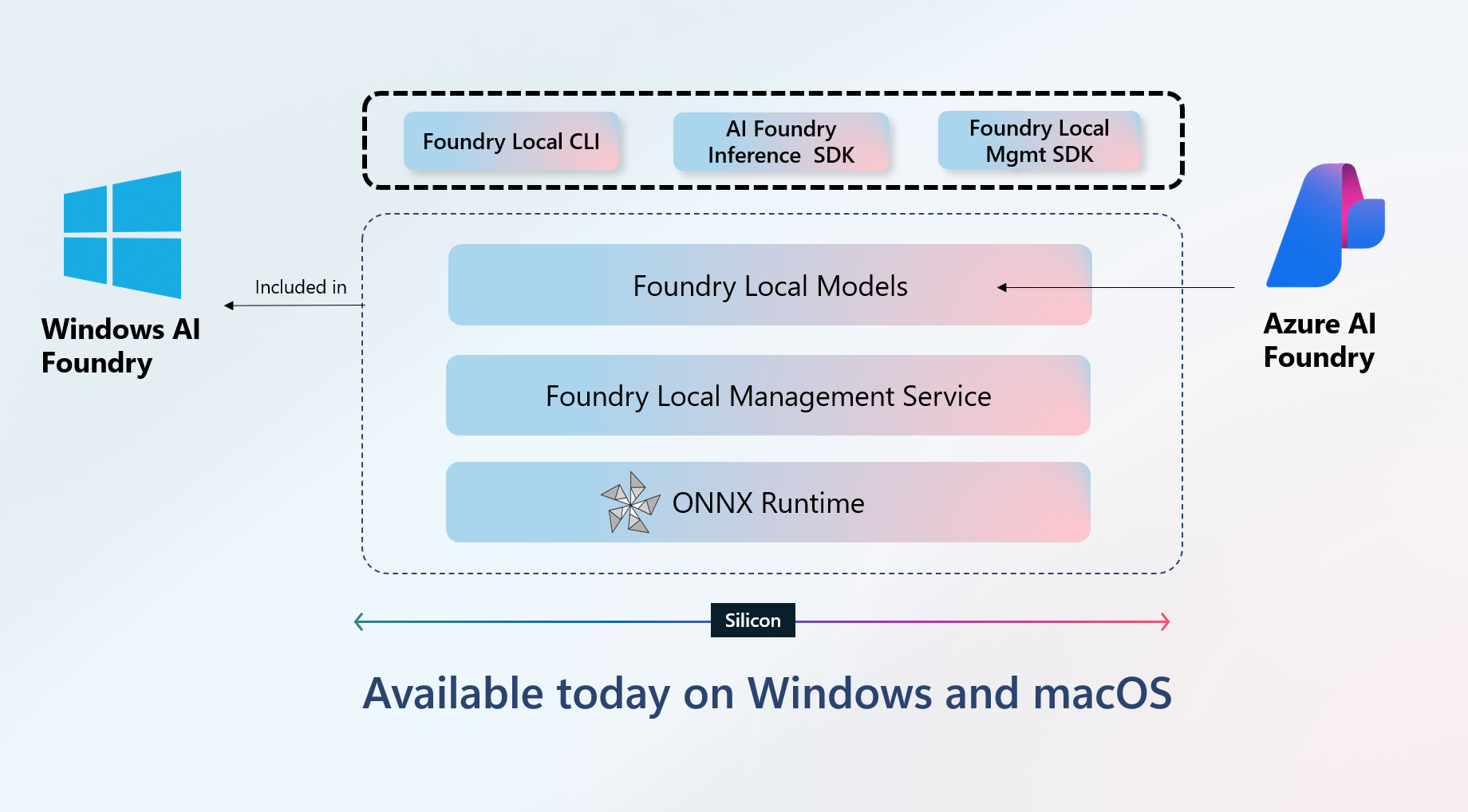

🌐 生态开放与云边端协同:全场景无缝覆盖

在生态和部署层面,微软通过 Foundry Model、A2A 协议、MCP(模型上下文协议)构建了高度开放、智能体协同的AI生态系统。Foundry Local 的发布,让AI能力延伸到本地与边缘设备,实现云、边、端的无缝协同,满足企业在数据隐私与实时性的全方位需求。

✨ 个人感悟:让安全治理“飞入寻常企业”,人人可用

作为一名网络安全从业者,我对微软AI安全战略有两层深刻体会。一方面,AI越强大,企业对数据安全、合规和隐私的需求越迫切。另一方面,安全治理绝不能只是阳春白雪,更要像水和电一样,成为企业随时可用、人人可享的基础能力。

微软用一整套工具化、服务化的安全治理方案,把“安全”从抽象原则变成了实际可落地的服务,把过去难以量化、难以见效的治理价值显性化,让AI真正“用得安心、管得明白”。不管是自动防护的Prompt Shield、任务越界监控的Task Adherence,还是开发流程里的Defender集成和PII检测,这些能力都让企业和开发者能“看得见、用得上、改得快”。

这给所有网络安全治理工作者带来了重要启示:安全治理不能只停留在理论层面,必须深入业务流程和日常场景,通过工具化、服务化的方式,让企业和个人都能直观体验到安全带来的实际价值。