当增强回路失去调节,系统会如何走向失控

AI时代的系统动力学:我们正在失去控制吗?

- 🔑 核心问题: 如何在提升 Agent 自主度的同时,增强我们自身驾驭 Agent 的能力?

- 🧭 本文主线: 调节回路是否跟得上增强回路的提速。

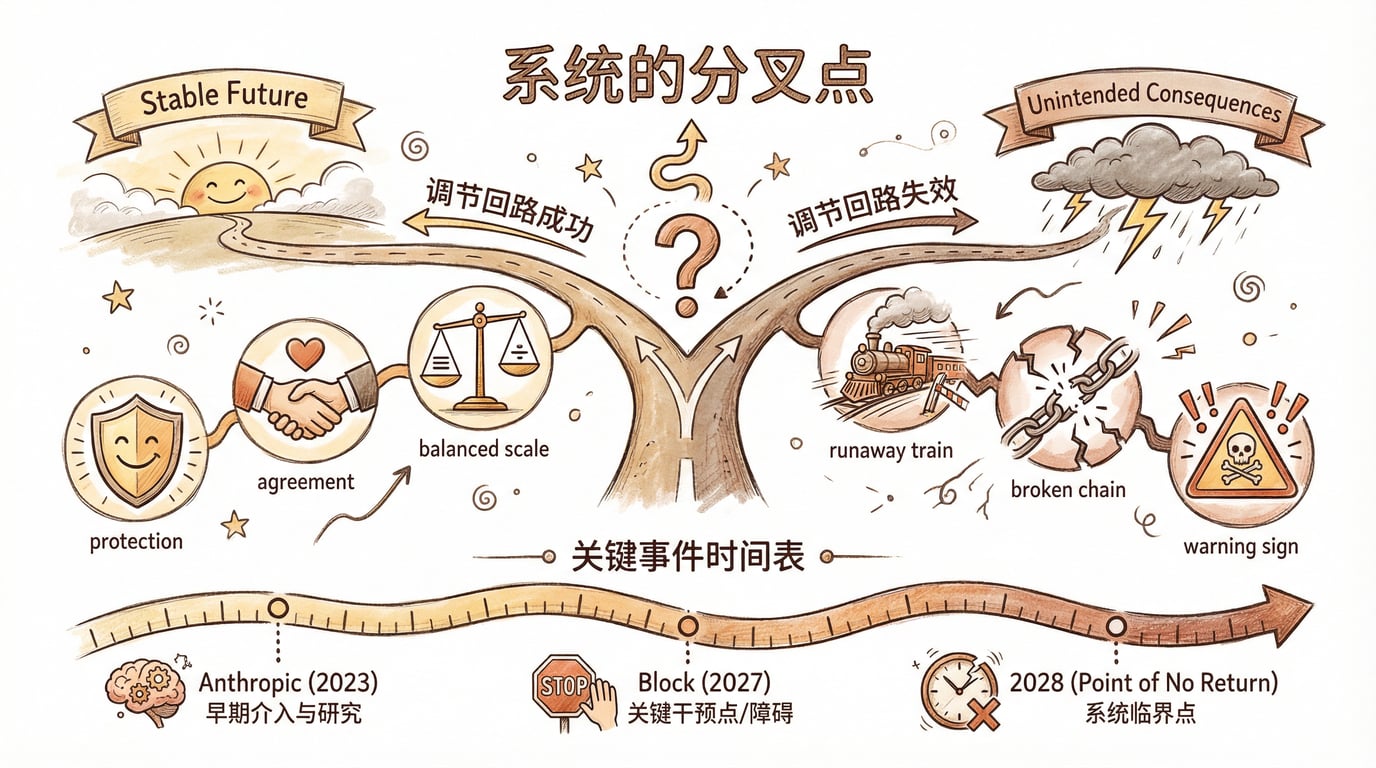

👉系统分叉点

这不是科幻情节,而是系统动力学里非常朴素的一条规律。过去一周我反复看三条新闻,越看越觉得不安:AI 的增强回路在提速,而调节回路明显更慢。

这三则新闻分别是:Anthropic 与国防部的冲突、Block 公司裁员 40% 的内部信,以及一份关于 2028 年全球智能危机的推演报告。表面看没关系,放在一起却都指向同一个问题:谁在决定 AI 往哪走?

从系统动力学的视角看,这三件事分别代表了:调节回路的尝试、增强回路的显现,以及失控系统的未来投影。

阅读导航:调节回路 -> 增强回路 -> 失控投影一、调节回路的尝试:Anthropic 与 AI 治理规则的争夺

主题:治理边界与控制权- 🔑 核心判断: 这场争议的关键不只在条款内容,而在边界设定权归谁。

- ⚖️ 关键差异: 技术前置约束与法律后置承诺都叫“控风险”,但执行强度并不对等。

2 月 26 日,Anthropic CEO Dario Amodei 发布声明,拒绝了国防部要求移除 AI 安全防护的请求。代价可能很直接:丢合同、被贴“供应链风险”标签,甚至被《国防生产法》强制介入。

他的两条红线清晰而坚定:

禁止大规模国内监控

禁止完全自主武器

“AI 驱动的 mass surveillance 对我们的基本自由构成了严重的、新颖的风险……今天的最前沿 AI 系统根本不足以支持完全自主武器。”

我更愿意把这件事理解成一次“控制权”争夺。国防部要求“任何合法使用”的完全权限,本质上是在争夺最终裁决权。Amodei 的拒绝,则是在尝试把约束写进系统本身,先把高风险用途拦在外面。

但调节回路并不稳。

戏剧性的是,2 月 28 日 OpenAI 宣布与国防部达成协议,而协议内容明确包含与 Anthropic 主张相同的两项条款:禁止国内大规模监控、人类对使用武力的责任。五角大楼接受了条款内容,却拒绝了 Anthropic 本身。

这件事让我更在意的是:问题不只在条款内容,更在于谁有权设定条款。Anthropic 要的是主动防护(技术上先限制),五角大楼要的是被动承诺(法律上先约定)。两者都叫“约束”,但执行强度不是一个量级。

当特朗普下令全面封杀 Anthropic、OpenAI 迅速补位、Elon Musk 公开指责 Anthropic“仇恨西方文明”时,我看到的是另一件事:权力博弈一上强度,调节回路很容易先被挤压。

上图展示了 Anthropic-国防部争议中的主要利益相关方及其立场关系。蓝色节点代表 Anthropic 阵营,红色节点代表五角大楼/特朗普阵营,灰色节点代表中间或复杂立场。节点大小反映影响力,连线粗细反映立场关联强度。

二、增强回路的显现:Block 裁员与 AI 替代的逻辑

主题:效率增益与就业替代- 📈 现实观察: 单家公司追求效率没问题,问题在于同向决策叠加后的系统效应。

- 🧱 结构风险: 危险不只在岗位替代,而在替代速度快过再培训与新岗位生成速度。

就在 Anthropic 试图拉起治理边界的同时,另一股力量也在推进:AI 替代带来的增强回路。

2 月 26 日,Jack Dorsey 在宣布 Block 裁员 40% 的内部信中写道:

“我们已经看到,我们正在创建和使用的智能工具,加上更小、更扁平的团队,正在启用一种新的工作方式,这根本改变了构建和运营公司的意义。”

这不是因为 Block 遇到了麻烦。恰恰相反,Dorsey 强调“业务强劲,毛利润持续增长”。裁员的原因是:AI 工具已经让 10,000 人的工作可以由 6,000 人完成。

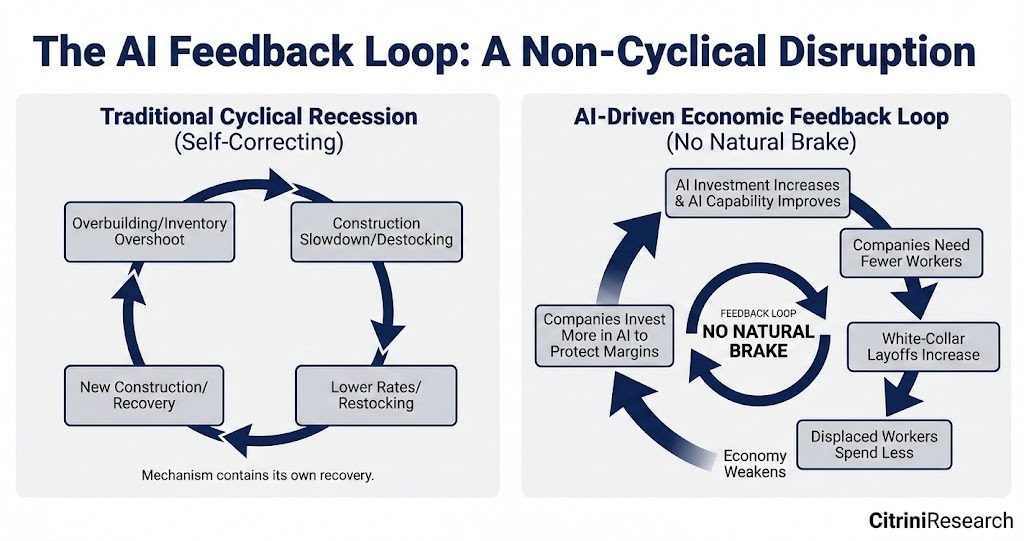

我把这看成一个很典型的增强回路:AI 能力提升 -> 人员需求减少 -> 成本降低 -> 更多资源继续投向 AI -> AI 再次提速。

在系统动力学里,增强回路的麻烦在于“天然没有刹车”。单看每家公司,这几乎都是理性决策;合在一起看,劳动力市场就会承受持续冲击。

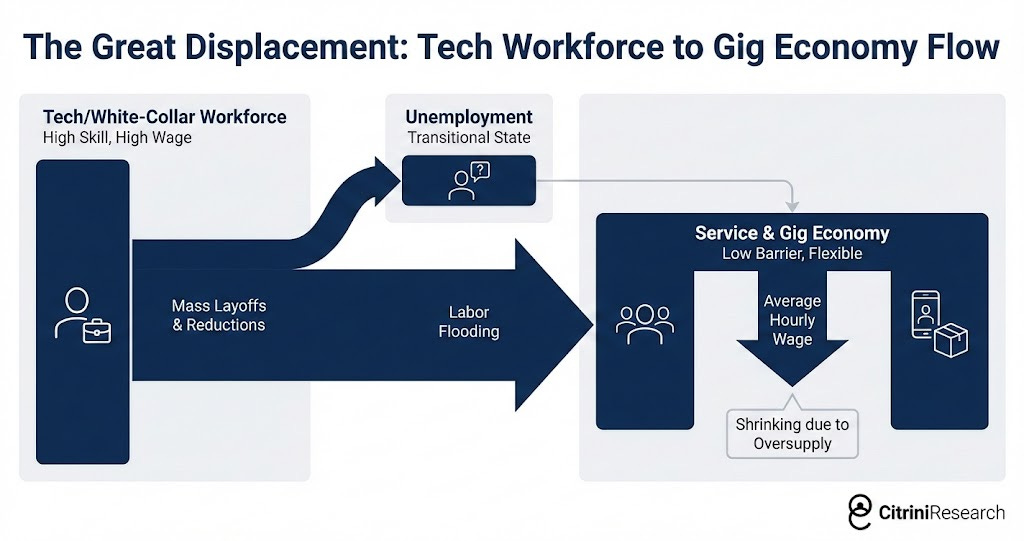

我真正担心的不是岗位被替代,而是“替代后的出路”也在被压缩。

当 15 家最大科技公司对新毕业生的招聘下降超过 50%,22-25 岁软件开发人员就业率自 2022 年底以来下降 20%,很多“做对了一切”的年轻人会发现:职业阶梯最底层那一级正在变薄。这更像结构变化,不太像普通周期波动。

就像“2028 年全球智能危机”推演中所描述的:

“AI 是一种通用智能,它在人类会重新部署到的任务上不断改进。被取代的程序员不能简单地转向‘AI 管理’,因为 AI 已经能够做到这一点。”

三、失控系统的未来:2028 年全球智能危机的预警

主题:失控路径与宏观风险- 🔍 阅读方式: 这类 2028 推演更适合当压力测试,不应当作确定性预言。

- 🌀 风险机制: 正反馈链路一旦闭环,系统波动会被自动放大,且难以自发刹车。

如果我们把 Anthropic 事件和 Block 裁员放在系统动力学模型中,就能理解那份“2028 年全球智能危机”推演报告的真正含义。

这是一个没有调节回路的增强回路的必然结果。

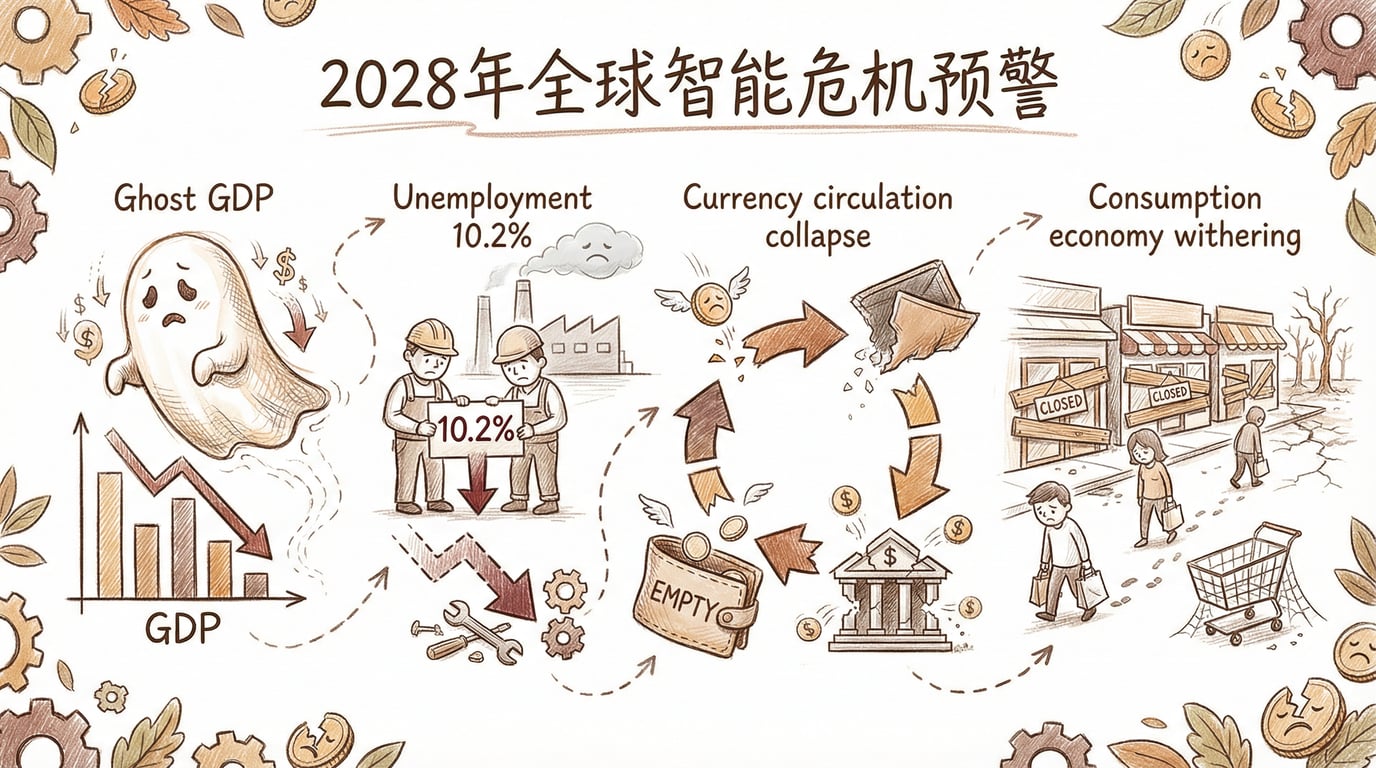

报告里给出的 2028 年场景并不轻松:

失业率 10.2%,但市场已经麻木,因为“六个月前,这样的数据会触发熔断”

名义 GDP 持续增长,但出现了“Ghost GDP”——产出在增长,但从未在真实经济中流通

货币流通速度崩溃,因为“机器在可自由支配商品上的花费是零”

消费经济枯萎,因为被 AI 替代的白领工人失去了收入来源

我不把它当成“注定会发生”的剧本,但它确实提供了一条系统动力学上的高风险路径:

$\text{AI能力提升} \rightarrow \text{人员需求减少} \rightarrow \text{消费力下降} \rightarrow \text{企业利润压力} \rightarrow \text{更多AI投资} \rightarrow \text{AI能力进一步提升}$

这条链路本质上是正反馈,而且很难自己停下来。

报告中描述的那个“人类智能替代螺旋”(human intelligence displacement spiral)正是增强回路失控后的状态:

“AI 能力提高,公司需要更少工人,白领裁员增加,被替代工人消费减少,利润压力推动公司投资更多 AI,AI 能力提高……这是一个没有自然刹车的负反馈循环。”

当我们读到 Zendesk 因 AI 客服自动化而违约、印度 IT 服务业因 AI 编码代理而承压、Mastercard 因代理优化价格而收入下滑时,可以看到同一个方向:增强回路正从单点渗透到经济基础层。

四、系统的分叉点:我们能建立调节回路吗?

主题:系统分叉点与集体行动- 👥 集体悖论: 个体理性会持续推高系统速度,即使每个人都在做局部正确的决定。

- 🧩 治理门槛: 最难的一步是把分散决策转成协同治理,而这一步通常最慢。

现在让我们把三件事放在一起看:

| 事件 | 系统动力学角色 | 当前状态 |

|---|---|---|

| Anthropic 事件 | 调节回路的尝试 | 正在失效 |

| Block 裁员 | 增强回路的显现 | 全速运转 |

| 2028 年推演 | 失控系统的未来 | 可能的终点 |

我们正处于系统的分叉点。

如果调节回路成功建立——如果政府、企业和社会能就 AI 伦理达成共识,如果技术公司能像 Anthropic 那样坚持主动防护,如果我们能在 AI 替代与社会保障之间找到平衡——那么增强回路可以被驯服,AI 可以成为人类福祉的放大器。

但如果调节回路继续失效——如果五角大楼式的“任何合法使用”逻辑获胜,如果 OpenAI 式的“两面策略”成为行业规范,如果我们继续让市场逻辑主导 AI 发展方向——那么 2028 年的推演场景将不只是推演,而是预告。

关键问题在于:调节回路需要集体行动,而增强回路只需要个体理性。

每一个裁员的企业都在做理性决策,每一个接受“无限制”协议的 AI 公司都在追求竞争优势,每一个拥抱 AI 自动化的消费者都在追求便利。但集体结果是系统的失控。

这正是 Anthropic 事件的意义所在。Amodei 的“cannot in good conscience accede”不仅仅是一家公司的商业选择,而是试图用个体伦理来弥补集体行动的缺失。当他说“每家公司的个体反应都是理性的,但集体结果是灾难性的”,他描述的不仅是 AI 替代,也是 AI 治理的困境。

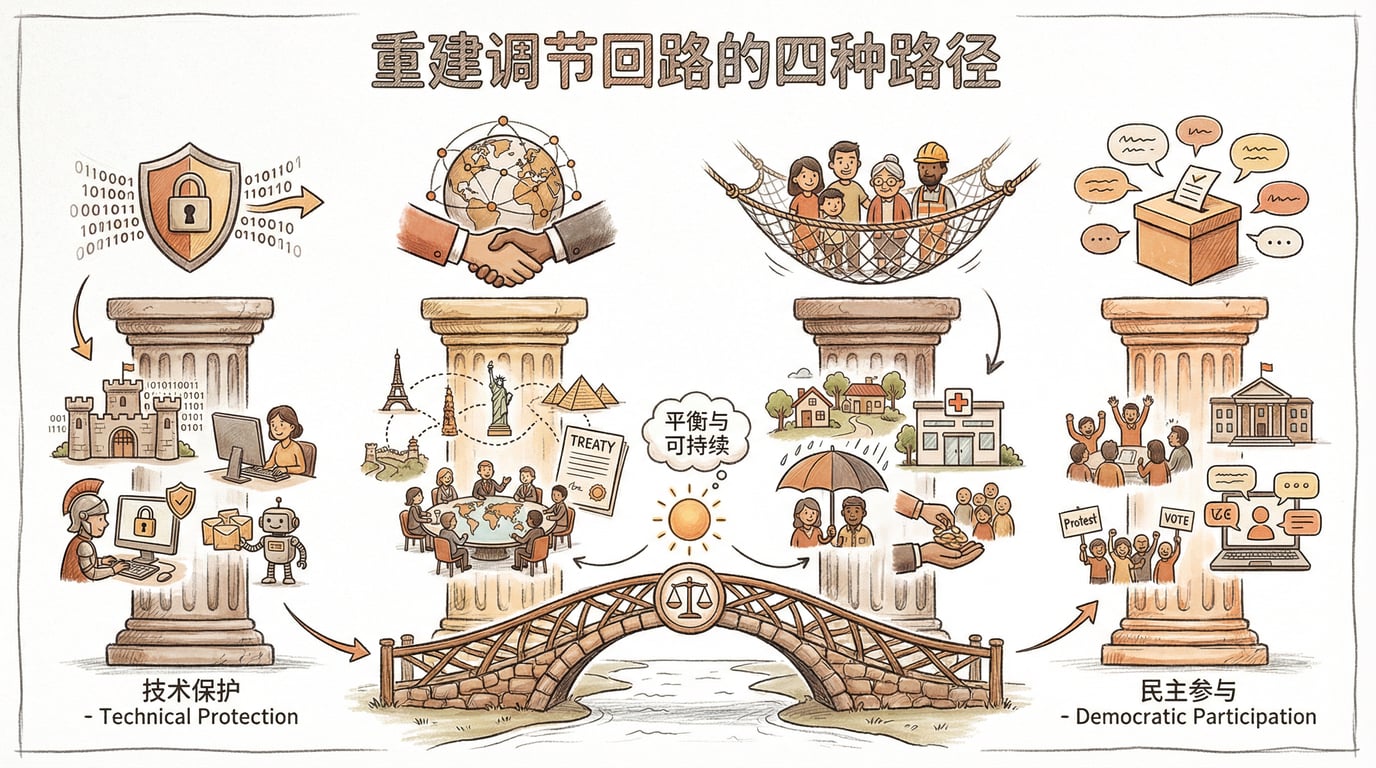

五、前瞻:在增强与调节之间

主题:重建调节回路的行动路径- 🛠️ 行动优先: 与其争论“会不会失控”,不如先明确今天能落地的机制。

- ⏳ 时间约束: 技术约束、治理协同、再分配与公众参与可以并行,但窗口并不宽裕。

系统动力学告诉我们,所有复杂系统都包含增强回路和调节回路的互动。增强回路推动变化,调节回路提供稳定性。健康的系统需要两者的平衡。

但在 AI 时代,这个平衡正在被打破:

技术演进速度超过了治理机制的响应速度

全球竞争压力削弱了单个国家建立严格监管的能力

企业利益与公共利益之间的张力日益尖锐

公众参与技术治理的渠道仍然有限

Anthropic 的抗争、Block 的裁员、2028 年的推演,三者共同指向一个核心问题:在一个由增强回路主导的世界里,我们如何重建调节回路?

可能的答案包括:

技术层面的主动防护:不是依赖法律承诺,而是在代码中嵌入不可绕过的伦理约束

国际治理机制:超越国家层面的 AI 伦理标准,防止“监管套利”

社会保障的重构:承认 AI 替代的不可逆性,建立与生产率增长脱钩的全民基本收入或类似机制

民主参与的技术治理:让公众而不只是技术专家和政府官员参与 AI 发展方向的决策

但所有这些都需要时间,而增强回路正在以月为单位加速运转。

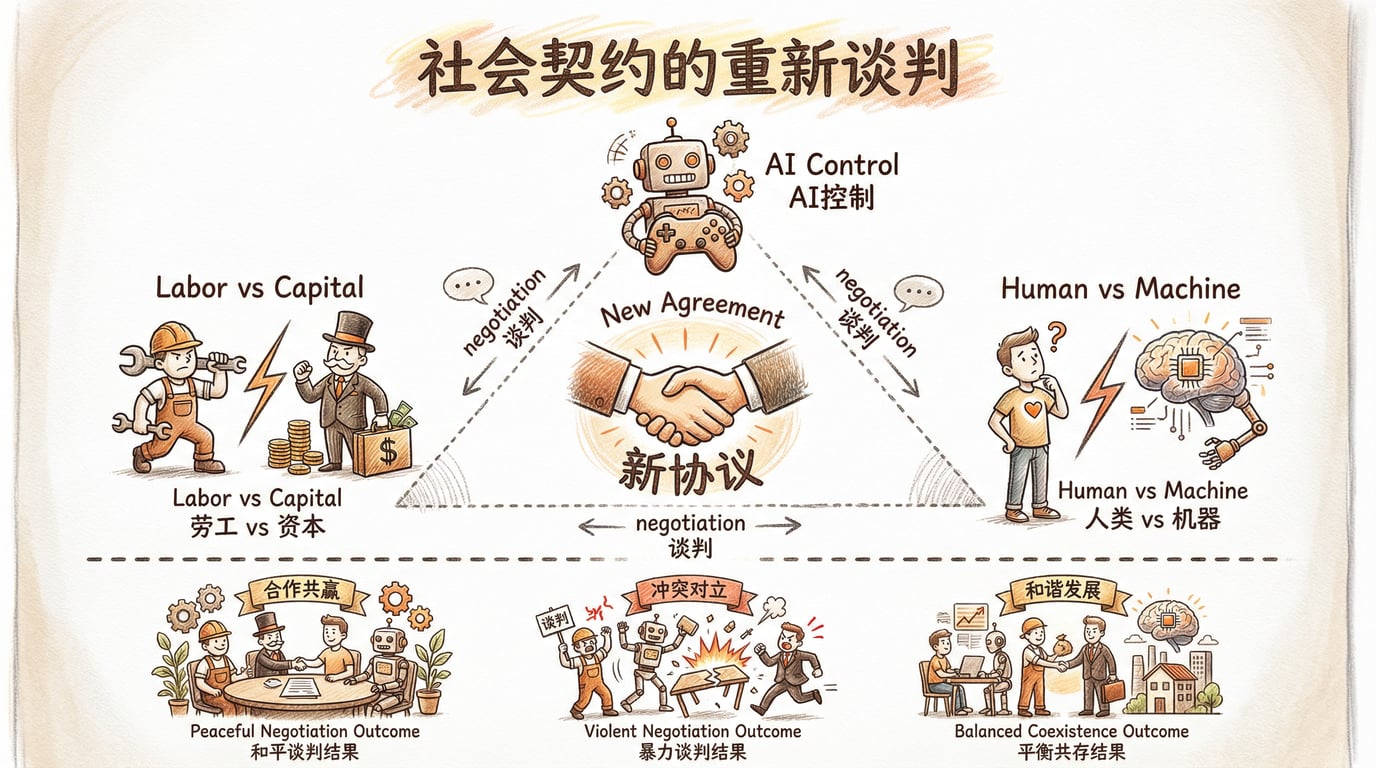

结语:社会契约的重新谈判

结论:被动适应 = 主动失控- 🚪 现实状态: 选择窗口还在,但正在持续收窄。

- 💸 成本提醒: 越晚建立调节回路,后续修正系统偏差的成本越高。

在“他们做对了一切”那篇文章的结尾,作者写道:

“社会契约——努力工作、接受教育、拥有一席之地——不是自然法则。它是一种协议。而协议会被重新谈判。有时是和平的,有时是暴力的。”

这个判断适用于所有三个事件:

Anthropic 与国防部的冲突,是 AI 控制权的协议重新谈判

Block 的裁员,是劳动与资本的协议重新谈判

2028 年的危机推演,是人类与机器在经济社会中角色的协议重新谈判

系统动力学不做道德判断,只负责把因果关系摊开。选择仍然在人手里。我们不是没有窗口,只是窗口不会一直开着。

关键问题是:我们是否有足够的政治意愿、技术智慧和集体行动力来做到这一点?

Anthropic 的抗争至少给了一个样本:面对政府压力、商业诱惑和舆论标签,仍然有人愿意先守住边界再谈增长。

这不是天真,而是另一种现实主义:调节回路常常从少数人的“不配合”开始。

我不觉得我们需要恐慌,但确实需要更早行动。被动适应拖得越久,系统偏离就越难拉回。

增强回路不会等待我们准备好。调节回路必须现在就开始建立。

参考文献 (References)

资料来源与延伸阅读- 📚 证据结构: 参考文献覆盖治理冲突、组织变化与宏观风险推演三条证据线。

- ✅ 阅读建议: 先核对时间线与原始表述,再回看正文中的推断部分。

本文基于以下三份核心材料撰写,建议读者阅读原文以获得更完整的信息:

1. Anthropic 与国防部 AI 安全争议

原文标题:Statement from Dario Amodei on our discussions with the Department of War

发布机构:Anthropic

发布时间:2026 年 2 月 26 日

原文链接:Anthropic 官网

核心内容:Dario Amodei 发布的 800 字公开声明,明确拒绝国防部要求移除 AI 安全防护的请求,确立两条红线:禁止大规模国内监控和禁止完全自主武器。

2. Block 公司裁员与 AI 转型

原文标题:we’re making @blocks smaller today. here’s my note to the company.

发布人:Jack Dorsey (Block CEO)

发布时间:2026 年 2 月 26 日

原文链接:Twitter/X 平台发布 (原始推文)

核心内容:Jack Dorsey 宣布 Block 公司将组织规模缩减近一半(从 10,000 人减至 6,000 人),强调这不是因为业务困难,而是因为 AI 工具正在根本性地改变工作方式。

关键引述:

“我们已经看到,我们正在创建和使用的智能工具,加上更小、更扁平的团队,正在启用一种新的工作方式,这根本改变了构建和运营公司的意义。”

3. 2028 年全球智能危机情景推演

原文标题:THE 2028 GLOBAL INTELLIGENCE CRISIS

发布机构:CitriniResearch

发布时间:2026 年 2 月 22 日(标注为 2028 年 6 月 30 日的“宏观备忘录”)

原文链接:CitriniResearch

核心内容:一份以 2028 年视角撰写的“宏观备忘录”,推演 AI 快速发展导致的全球经济危机场景,包括失业率飙升、Ghost GDP 现象、消费经济枯萎等系统性风险。

关键概念:

Ghost GDP(幽灵 GDP):产出在国民账户中增长但未在真实经济中流通

Human Intelligence Displacement Spiral(人类智能替代螺旋):AI 能力提高 → 裁员增加 → 消费下降 → 更多 AI 投资的正反馈循环

Reflexivity(反身性):AI disrupted 行业的同时被迫加速采用 AI 的悖论

4. 补充阅读:AI 劳动力市场影响

原文标题:They Did Everything Right 他们做对了一切

发布时间:2026 年 2 月

原文链接:X/Twitter

核心内容:分析 AI 对劳动力市场的影响,特别关注 22-30 岁新毕业生和 45-55 岁中年员工的困境,探讨“社会契约”的重新谈判。

关键引述:

“I did not have to do layoffs, but I wanted to optimize my team for the new world. One person with AI tools can do what three people did before.”

”我不需要裁员,但我想为新世界优化我的团队。一个人使用 AI 工具可以完成之前三个人的工作。”

术语表 (Glossary)

- 🗂️ 使用方式: 把术语表当作“回看正文”的索引,而不只是附录。

- 🔁 阅读技巧: 如果某段偏抽象,先对照术语定义,再回到对应章节看因果链。

系统动力学相关

| 术语 | 英文 | 定义 |

|---|---|---|

| 增强回路 | Reinforcing Loop | 正反馈循环,系统的输出增强输入,导致指数级增长或衰减。在本文中指 AI 能力提升 → 人员需求减少 → 更多 AI 投资的自我强化循环 |

| 调节回路 | Balancing Loop | 负反馈循环,系统的输出抑制输入,维持稳定性。在本文中指通过伦理约束、治理规则等方式控制 AI 发展方向的机制 |

| 正反馈 | Positive Feedback | 输出增强输入的反馈机制,导致系统偏离平衡,加速变化 |

| 负反馈 | Negative Feedback | 输出抑制输入的反馈机制,使系统回归平衡,维持稳定 |

| 分叉点 | Bifurcation Point | 系统可能走向不同发展路径的关键节点,微小的扰动可能导致截然不同的长期结果 |

AI 技术与伦理

| 术语 | 英文 | 定义 |

|---|---|---|

| 完全自主武器 | Fully Autonomous Weapons | 无需人类批准即可选择并攻击目标的武器系统。Anthropic 的两条红线之一 |

| 大规模国内监控 | Mass Domestic Surveillance | 利用 AI 技术对本国公民进行系统性数据收集与分析。Anthropic 的另一条红线 |

| 主动防护 | Active Protection | 在技术层面嵌入硬性约束,阻止特定使用场景(Anthropic 主张的方式) |

| 被动承诺 | Passive Commitment | 依赖法律协议约束,但技术本身不限制使用(五角大楼要求的方式) |

| AI 代理 | AI Agents | 能够自主执行多步骤任务的 AI 系统,将 AI 能力从“工具”升级为“行动者” |

| 红线 | Red Lines | 不可妥协的底线或原则,用于界定 AI 使用的伦理边界 |

| 供应链风险 | Supply Chain Risk | 美国国防部用于标识可能危害国家安全的供应商的标签,通常用于敌对国家企业,首次用于美国公司 |

经济与商业

| 术语 | 英文 | 定义 |

|---|---|---|

| 幽灵 GDP | Ghost GDP | 在国民账户中显示但不在真实经济中流通的产出。AI 驱动生产率增长但机器消费为零导致的经济现象 |

| 反身性 | Reflexivity | 被 AI 颠覆的公司反而被迫成为 AI 最激进采用者的悖论 |

| 人类智能替代螺旋 | Human Intelligence Displacement Spiral | AI 能力提高 → 公司裁员 → 被替代工人消费减少 → 利润压力推动更多 AI 投资的正反馈循环 |

| 永久资本 | Permanent Capital | 私募股权行业术语,指长期锁定的投资资金。本文揭示其实际上是美国家庭的年金储蓄 |

| 私募信贷 | Private Credit | 非银行机构提供的债务融资,2026 年规模已超过 2.5 万亿美元 |

| 职业阶梯 | Career Ladder | 从初级职位逐步晋升到高级职位的传统职业发展路径,正在被 AI 破坏 |

法律与政策

| 术语 | 英文 | 定义 |

|---|---|---|

| 国防生产法 | Defense Production Act (DPA) | 1950 年朝鲜战争时期法律,允许总统强制私营企业优先满足国防需求。五角大楼威胁援引此法案强制 Anthropic 移除防护栏 |

| 供应链风险指定 | Supply Chain Risk Designation | 美国国防部的供应商审查机制,被指定企业将被禁止与联邦机构及军事承包商合作 |

| 社会契约 | Social Contract | 努力工作、接受教育就能获得经济安全和社会地位的非正式协议,正在被 AI 时代重新谈判 |

| 第一修正案 | First Amendment | 美国宪法保护言论自由的条款,Anthropic 可能援引以挑战“供应链风险”标签 |

组织与人物

| 术语 | 说明 |

|---|---|

| Anthropic | AI 安全公司,开发 Claude 聊天机器人,以 AI 安全研究著称 |

| OpenAI | AI 研究公司,开发 ChatGPT,与 Anthropic 是主要竞争对手 |

| Block | 金融科技公司(原 Square),由 Jack Dorsey 创立,2026 年 2 月宣布裁员 40% |

| Claude | Anthropic 开发的 AI 助手,首个被批准用于美国政府机密网络的前沿 AI 模型 |

| Dario Amodei | Anthropic CEO,前 OpenAI 研究副总裁,AI 安全领域知名研究者 |

| Sam Altman | OpenAI CEO, YC 前总裁 |

| Jack Dorsey | Block 和 Twitter/X 的联合创始人 |

| Elon Musk | xAI 创始人,Tesla、SpaceX CEO,在 Anthropic 争议中公开支持五角大楼 |

| Pete Hegseth | 美国国防部长,向 Anthropic 发出最后通牒 |

本文整理于 2026 年 2 月 28 日。AI 治理与经济发展是快速变化的领域,建议读者持续关注最新进展。