这不是一次工具升级,而是网络安全从“手工作坊”走向“机器协同流水线”的重构

🤖 当 AI 学会了提交 PR:网络安全工程师真正的危机,是被“重新定价”

想象这样一个场景:过去,一个安全团队可能要花上两周时间,在成千上万行代码和日志中翻找,最后丢给开发团队一份几十页的渗透测试报告。开发人员看着满屏的“高危”、“中危”头疼不已,排期修复又要等上一个月。

但现在,这个流程正在被改写。

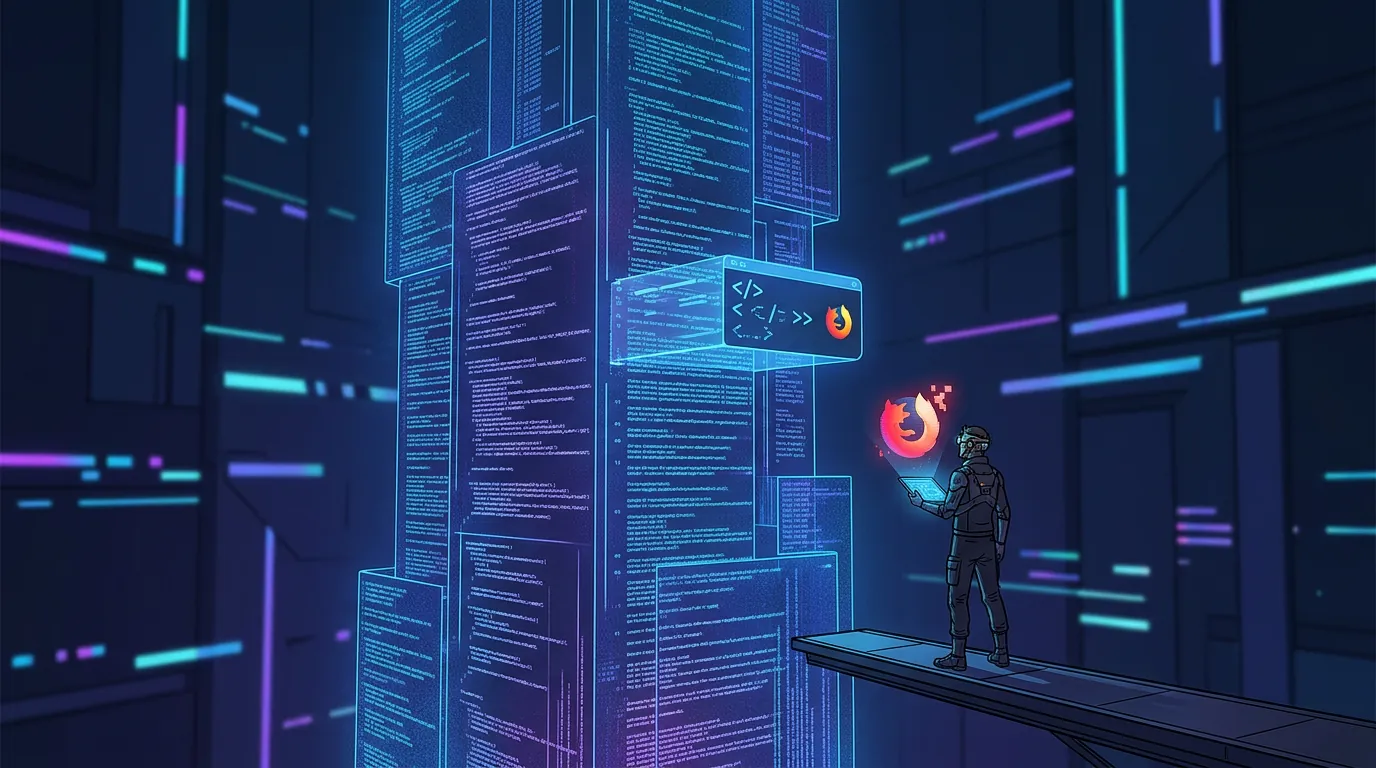

2026 年初,Anthropic 的 Claude Opus 4.6 仅仅花了 20 分钟,就在 Firefox 极其复杂的底层引擎中发现了一个高危漏洞[1]。而 OpenAI 最新推出的 Codex Security 则更进一步:在 30 天的测试里,它不仅找出了 700 多个严重漏洞,甚至直接在沙箱里跑通了攻击验证,并自动生成了修复代码的 PR(Pull Request)[2]。

当 AI 不仅能“指出问题”,还能“动手修好问题”时,很多网安工程师心里大概都会闪过一个念头:我的饭碗,是不是快保不住了?

🎯 别用“辅助论”来安慰自己

面对 AI 的冲击,很多人喜欢用一种“辅助论”来缓解焦虑。

大家会说:“AI 嘛,无非就是一个更聪明的代码扫描器。它误报率那么高,最后那些高价值的判断、漏洞的验证,还有修复代码的提交,不还是得靠我们人类工程师来闭环吗?”

如果是两年前,这个想法是对的。过去的安全自动化(比如各种 SOAR 工具),顶多是帮你自动写写防护规则,或者把一堆告警汇总到一起。它们是来“打下手”的。

但 Codex 和 Claude 的最新表现,无情地戳破了这个隐性假设。它们不再是只会报错的扫描器,而是开始在沙箱环境里主动制造攻击脚本(POC)来验证漏洞的真伪,确认能攻击成功后,再自己写补丁、自己提交 PR。

这意味着,在一部分规则明确、步骤重复的受控任务里,AI 已经开始逼近不需要人类逐步介入的闭环状态。

⚗️ 真正的危机,是整个行业被“重新定价”

那么,这代表 AI 已经比顶级黑客更聪明了吗?并不是。

事实上,Anthropic 最近正在砸重金——开出高达 40 万美金的年薪,四处招募顶级的“进攻性安全工程师”[3]。原因很简单:AI 找漏洞很便宜,但它还不太会写复杂的真实攻击代码。顶级 AI 公司花大价钱买人类专家的经验,是为了给 AI 搭建一套“进攻脚手架”。

这件事的本质,不是 AI 变得全知全能,而是它把过去极度昂贵的安全动作,做得不可思议的便宜。

这才是真正的危机所在——单位成本的断崖式下降。

你可以设想一下:如果过去甲方愿意花几十万,请传统的安全服务公司做一次按月计费、按人头算钱的渗透测试项目。现在如果有一个 AI 系统,能 24 小时挂在代码库上持续扫描,还能直接给你提修复 PR,客户为什么还要为低效的旧模式买单?

AI 不是在取代某个特定的工程师,它是在重写整个网络安全行业的定价逻辑。那些只会跑工具、收集结果、套模板写报告的“搬运型”岗位,其市场议价能力将会面临明显的下降。

🔭 超级个体的崛起与“AI 的新面孔”

旧的饭碗在贬值,但新的杠杆正在成型。

当纯手工挖洞变得不那么值钱时,市场上最稀缺的,变成了那些懂 AI、会调教 AI、能把 AI 纳入工作流的人。

独立研究者 Jim Nightingale(网名 “Jim the AI Whisperer”)就是一个绝佳的例子 [4]。他原本并不是在大厂里按部就班写渗透报告的传统工程师。从 2021 年起,他就凭借着纯粹的热情,疯狂地对各大语言模型进行压力测试,破解它们的提示词,寻找模型的安全漏洞。更重要的是,他坚持把这些硬核的研究输出成文章。他没有靠传统的职级头衔,而是纯粹依靠持续的红队研究输出,把自己送进了一条全新的赛道。

结果是,专业 AI 安全公司 Mindgard 看中了他,将他高薪网罗,成为专门的 AI 红队测试(Red Teaming)研究员。

Jim 的故事告诉我们:未来拼的不是谁肉眼找 Bug 快,而是谁能更好地驾驭 AI。当你一个人就能用 AI 跑通从扫描到修复的全流程,你一个人,就是一家完整的安全公司。

不过,职业机会增加,并不意味着这件事只有光明的一面。硬币的另一面是,当 AI 变成了你的“超级员工”后,最大的安全风险,也变成了 AI 本身。

过去,安全工程师防的是外面的黑客。

未来,当你允许 AI 自动去改代码、调配置、动基础设施时,防线的内部就多了一个拥有强大执行权的“智能体”。

谁来保证这个 AI 不会因为被恶意污染,而提交一个带有隐蔽后门的 PR?谁来审计这个 Agent 的工具调用权限和每一次行动?

这就催生了一个全新的安全战场。

🔍 “企业深水区”不再是天然护城河

当然,一定会有老兵站出来反驳:

“AI 在开源项目里扫扫干净代码当然厉害。但你让它来看看我们公司这套跑了十年的祖传系统?错综复杂的网络边界、没人看得懂的业务逻辑,AI 扫出来的全是误报,根本不可能直接提交修复!”

这确实是当前的现实摩擦。但在过去,我们常常把这种“系统的晦涩和历史包袱”当成了人类工程师不可逾越的护城河。然而,最新的产业信号正在残酷地击碎这个幻想:

- Block (原 Square) 的万人大裁员:这家 Fintech 巨头近期一次性裁减了近 40%(约 4000 人)的员工 [5]。其 CEO Jack Dorsey 明确表示,内部孵化的 AI Agent “Goose” 从辅助编程扩展到了各业务线并极大提升了人效。这意味着,即使在金融科技这样极其复杂的深水区,Agent 也能开始规模化接管工作。

- IBM 的 AI 逆向接管:全球仍有数千亿行晦涩难懂的 COBOL 代码(支撑着庞大的银行交易系统)。IBM 推出的 watsonx Code Assistant 凭借大模型百万级的上下文带宽,已经能够一次性理解这些缺乏文档的“祖传代码”,并自动重构为现代 Java 微服务[6]。

企业复杂性正在从“人类工程师的保护伞”,退化为 AI 落地过程中的“临时摩擦”。

真正的护城河,根本不是比 AI 更熟悉老系统,而是你自身的进化能力(Adapt, Transfer, Uplift):你能不能主动转型为 AI 的管理者,搭建起能让 Agent 持续迭代的脚手架,把业务上下文、权限边界和验证机制有效地组织起来?一旦你完成了转身,你就会成为发起革命的人,而不是被革命的对象。

📌 写下预判,留待验证

接下来 12 到 18 个月,安全能力会继续沿平台化和 Agent 化方向前进。最先被平台吞掉的,不是漏洞扫描(SAST)本身,而是扫描之后那层高人力、低效率的“解释、修复与验证”流程。

如果我看清了这条脉络,我们大概率会看到以下几件事发生:

- 安全价值链的“一降一升”:只会“指出问题出报告”的传统安全服务模式将被边缘化,拥有沉重人力成本结构的传统厂商如果无法将 AI 嵌进工作流,其市值将面临大幅下滑;相反,那些以产品为中心、能提供“AI Agent 持续验证与自动闭环”的新型 AI 原生安全厂商(AI-Native Cybersecurity)将强势崛起。

- “调教 AI”的岗位溢价:市场上会出现大量极度具体的全新岗位,诸如“AI 模型红队测试(Model Red Teaming)”、“Agent 权限审计工程师”、“自动化攻防脚手架架构师”,并且薪资会远远甩开传统的 Web 安全工程师。

- 平台级标配化:像 GitHub、GitLab 这样的托管平台,会直接把具备“验证+自动提 PR”能力的 AI 安全 Agent 做成基础设施。开发者在提交代码的当下,Agent 就会在 PR 里直接附上可执行的补丁和验证结果。

当然,如果未来真的出现几次标志性的“AI 自动提交毒代码导致生产系统崩溃”的大规模事故,业界也可能重新退回到更保守的“只告警、不自动修复”路线,那说明我的判断过于乐观了。

📅 写于 2026-03-08,将在 2027-09-08 回顾此预判

说到底,AI 带来的不是安全工程师的末日,而是低价值“手工作坊”的黄昏。

在这个从手工转向“机器协同流水线”的过程中,网络安全的下一阶段竞争,不再是人与 AI 之间的对抗,而是“会组织 AI 的人”与“不会组织 AI 的人”之间的降维打击。

如果你的团队里,现在已经引入了类似 Codex 这样的安全自动化扫描工具,不妨问自己一个问题:你们的安全响应流程,是真的发生了质的改变,还是仅仅把它当成了一个“更快一点的报错器”?

参考资料 (References)

- Anthropic 官方博客: Partnering with Mozilla to improve Firefox’s security。Claude Opus 4.6 在 Firefox 代码库的测试中,仅耗时 20 分钟便发现了一个高危的 Use-After-Free 漏洞,并在两周内累计发现了 22 个严重漏洞。原文链接 ↩

- OpenAI 官方博客: Codex Security: now in research preview。Codex Security(前身为 Aardvark)不仅能构建项目特有的威胁模型,还能在沙箱中通过 POC 验证漏洞并自动生成修复 PR。在 30 天的测试中扫描了 120 万次提交,发现了 792 个严重漏洞。原文链接 ↩

- Anthropic 官方招聘公告: Offensive Security Research Engineer, Safeguards。Anthropic 为进攻性安全工程师开出了高达 $300,000 - $405,000 的基本年薪,旨在研究如何自动化传统的攻击技术,为模型搭建底层攻防脚手架。原文链接 ↩

- Mindgard 官方博客: Welcoming Jim Nightingale to Mindgard。独立安全研究者 Jim Nightingale(网名 Jim the AI Whisperer)凭借多年持续输出的硬核大模型压力测试与提示词破解内容,被专业 AI 安全机构网罗,正式成为红队测试研究员。原文链接 ↩

- AP News: Block shrinks to 6,000 employees as AI tools reshape company operations。Fintech 巨头 Block(Square 和 Cash App 的母公司)裁减约 4000 名员工。CEO Jack Dorsey 明确表示,这一裁员与公司全面引入 AI 智能工具(如内部 Agent Goose)带来的工作流重塑和效率提升密切相关。相关报道 ↩

- IBM 官方产品介绍: watsonx Code Assistant for Z。IBM 推出的生成式 AI 助手基于超大上下文的 Granite 模型,能够直接分析数十年前复杂且缺乏文档的单体 COBOL 遗留系统,并辅助将其重构、转换为现代化的 Java 服务,这标志着企业深水区代码正被 AI 的算力与上下文带宽逐渐解构。官方主页 ↩